Günümüzde kullanılan Microsoft Copilot, OpenAI ChatGPT veya Google Gemini gibi yapay zeka araçları ve bunları destekleyen modeller, geniş kapasiteli bulut sistemlerinde barındırılıyor. Bu modellerin milyarlar hatta trilyonlarca parametreye sahip olmaları nedeniyle akıllı telefonlar veya bilgisayarlar gibi cihazlarda çalışmaları zor. Ancak, Microsoft, piyasadaki en büyük dil modelleriyle benzer performansı sunabilen küçük boyutlu Phi-3 Mini modelini tanıttı.

Microsoft’un üzerinde çalıştığı Phi-3 Mini, 3.8 milyar parametrelik bir ağırlığa sahip kompakt bir yapay zeka dil modeli. Microsoft, bu aileyi yakında Phi-3 Small (7 milyar parametre) ve Phi-3 Medium (14 milyar parametre) ile tamamlamayı hedefliyor. Phi-3 Mini’nin küçük olmasına rağmen, 10 kat daha büyük diğer devasa modeller kadar güçlü olduğunu belirtiyor.

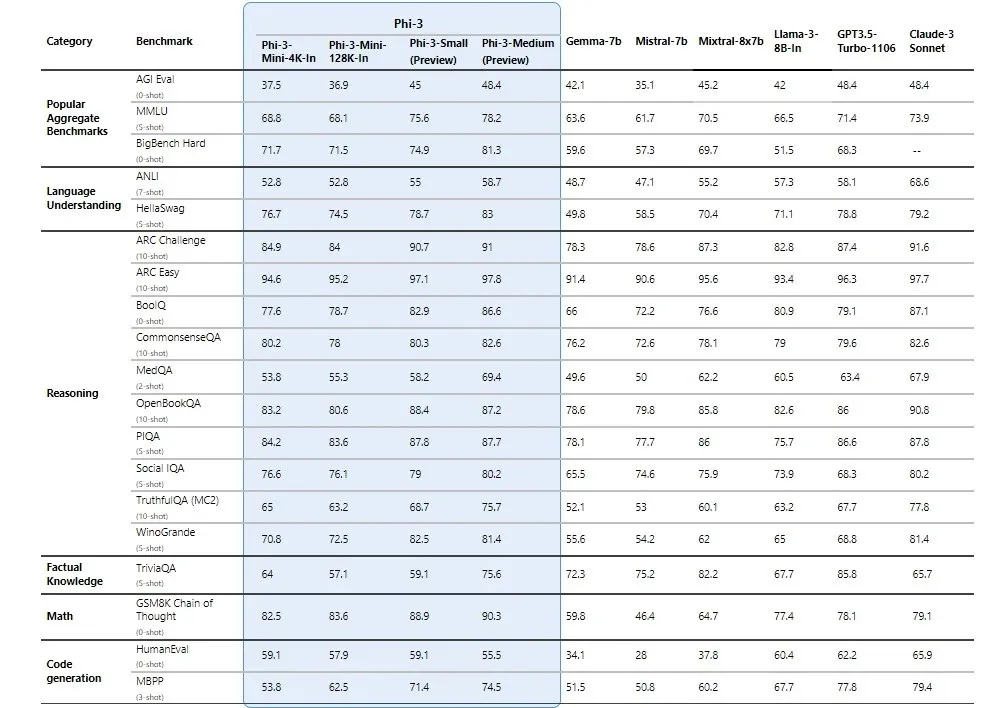

Microsoft tarafından paylaşılan verilere göre, Phi-3 Mini’nin, 175+ milyar parametreli GPT-3.5, Mistral’in Mixtral 8x7B modeli ve Anthropic’in Claude 3 Sonnet modeli gibi büyük modellerle rekabet edebildiği görülüyor. Önemli olan nokta, Phi-3 Mini’nin akıllı telefonlar gibi cihazlarda çalışabilen ve bulut bağlantısı gerektirmeyen bir yapay zeka modeli olması.

Yapay zeka modellerinin genellikle daha “zeki” olabilmesi için daha fazla parametreye ihtiyaçları vardır. Bu parametreler, modelin eğitim sırasında öğrendiği değişkenlerdir ve tahminlerde bulunmak veya kararlar almak için kullanılır. Daha büyük parametre sayısı genellikle daha sofistike ve karmaşık sorguların daha iyi anlaşılmasını sağlar. Ancak, bu daha fazla işlem gücü gerektirir ve hesaplama taleplerini artırır.

Microsoft’un araştırmacıları, Phi-3 Mini’nin eğitim verilerinin kendisini iyileştirerek şaşırtıcı sonuçlar elde ettiğini söylüyorlar. Günümüzün büyük yapay zeka modelleri, genellikle internet ve kütüphane verileriyle eğitilir, bu da “her şeyi” içerir; yani hem yararlı hem de yararsız bilgileri. Ancak, Microsoft Phi-3 Mini’yi yüksek kaliteli web içeriği ve önceki Phi modellerinden sentetik olarak oluşturulmuş materyallerle eğiterek, son derece seçkin bir veri kümesiyle besledi. Bu yaklaşım, modelin boyutuna göre güçlü bir performans sergilemesini sağladı ve nicelik yerine niteliğe odaklanıldı.

Ayrıca, modelin 4.000 token’a kadar bağlamı işleyebildiği ve 128k token’lık özel bir versiyonunun da mevcut olduğu belirtiliyor. Microsoft, bu modeli Azure, Hugging Face ve Ollama gibi platformlarda açık kaynak olarak kullanıma sundu. Şirket ayrıca yakında Phi-3 Small (7 milyar parametre) ve Phi-3 Medium’u (14 milyar parametre) da piyasaya sürmeyi planlıyor.